人工智慧(AI)的無窮威力,來自於它可以從大量的數據當中查找出潛藏的固定模式。

臉書利用AI研究衛星空照圖學習人們棲息地的樣貌,可以精確畫出全球貧窮地區的地圖。醫學研究者用手機訓練AI,可以學會偵查人體腫瘤的病灶。而谷歌的AI可以準確猜出某張照片是在哪一年拍的,只因為它看過的照片遠多於任何常人,而可以從中發現人類查覺不到的模式。

如今,科學家說人工智慧可以根據你的大頭像,準確猜出你是同性戀或是異性戀,甚至猜出你的智商或是政治立場。因為人工智慧可以被訓練查找臉部微妙的細部特徵,根據模式做出人們憑肉眼無法看出的結論。

根據美國史坦佛大學的研究,他們利用一套演算法分辨同性戀和異性戀,男性的準確率達到81%,女性的準確率則是74%。這項研究對於性取向的生物學起源、面部辨識技術的倫理等爭議。

這份發表於《人格與社會心理學》期刊的報告,根據樣本是下載自美國約會網站上的男女臉部影像。其中男性36630人共130741張圖,女性38593人,170360張圖。

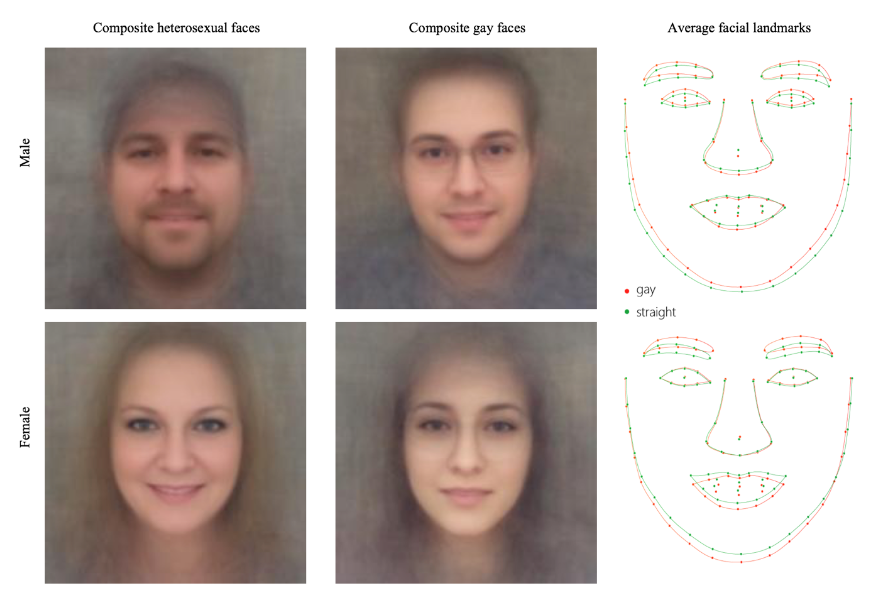

研究員科辛斯基(Michal Kosinski)和王怡倫(Yilun Wang,音譯)利用「深度神經網絡」擷取影像特徵。研究發現同性戀男女往往有「非性別典型」(gender-atypical)的特徵,它們的數據也呈現幾個趨勢。例如男同性戀和異性戀相比,下巴較窄、鼻子較長、前額較大,而女同性戀比起女異性戀下巴較寬、前額較小。

一般人根據外貌分辨同志的能力,明顯要比機器演算法差。辨識男性性取向的準確率是61%,女性的準確率是54%。

當機器觀察每個人五張臉部影像後,它的準確率甚至變得更高:男性準確率達91%,而女性為83%。按照論文作者的說法,這表示臉部所含有關於性取向的訊息,遠多於人腦所能夠感知和解讀。

作者也認為,他們的發現,對性取向是源自於出生前暴露於特定荷爾蒙的理論提供了「強烈支持」,這表示同性戀是源於天生而非後天的選擇。而機器對女性性取向猜測準確率低於男性,也可以用來支持女性的性取向較具流動性的觀點。

這些發現顯然也有許多侷限,這項研究的樣本僅限於白種人,同時也未考慮到跨性別或是雙性戀的人們。不過,它對人工智慧研究仍提供了一些值得警惕的啟示。如今在社群網站和政府機關的數據庫中,有數以億計的面部影像。這些公開的資料,可能在未經當事人同意下被用來分析判斷性取向。夫妻或是朋友之間,可能利用這套演算法來斷定對方是否是未出櫃的同志。而對LGBT團體不友善的政府或機構,也可能利用這套技術來攻擊特定的目標。換句話說,設計這樣軟體並宣傳它的準確性,本身就有爭議性並可能對社會造成危害。

這當然讓人不安。和其他任何新的工具一樣,如果它落入不當的人手中,可能被用來做各種壞事。

論文作者科辛斯基,過去也曾和英國劍橋大學合作研究心理計量分析,包括利用臉書的數據判定人格特質。過去英國脫歐的支持者和川普在總統大選裡都曾經利用類似工具來鎖定支持選民。也讓人們擔心選舉中,個人資料被濫用對選情的影響。

在這份研究裡面還提到,人工智慧也可被用來探索面部特徵與其他現象如政治觀點、心理狀況、或人格特質的關聯。隨著數據持續增加和演算法的不斷精進,機器「看透」你的機會越來越高,隱私可能也需重新定義。未來人們或許要擔心類似科幻電影《關鍵報告》的情節會在現實生活中上演,「你是什麼樣的人」將由人工智慧來判定,而人們也將單純因為「預期將會犯罪」而遭到逮捕。

人工智慧有足夠的數據就可告訴你任何人的任何事。問題在於:以社會而言,我們想要知道嗎?

參考資料:

New AI can guess whether you're gay or straight from a photograph(Guardian)

Advances in AI are used to spot signs of sexuality(Economist)